FPGAs und programmierbare SoCs: Grundlagen und Vorteile

Anbieter zum Thema

Bausteine, die auf Hardware-Ebene konfigurierbar sind, erfreuen sich zunehmender Beliebtheit – und machen den Einsatz klassischer Prozessoren zum Teil überflüssig. Zudem bieten FPGAs und programmierbare SoCs noch weitere Vorteile.

Field Programmable Gate Arrays (FPGAs) sind die Antwort der Branche auf maßgeschneiderte Schaltkreise (ICs) ohne die Entwicklungskosten, die normalerweise mit der Entwicklung eines ASIC einhergehen. Ihre Architektur unterstützt den Einsatz von anwendungsspezifischen digitalen Logiken, die eine wesentlich höhere Leistung erbringen können als ein Mikroprozessor mit der gleichen Aufgabe auf Software-Ebene.

Die Leistung gehört zu den zahlreichen Gründen dafür, warum FPGAs heutzutage so beliebt sind. Ihre Vorteile gehen aber noch viel weiter, weshalb sie sich für nahezu alle Anwendungsbereiche eignen.

Was ist ein FPGA?

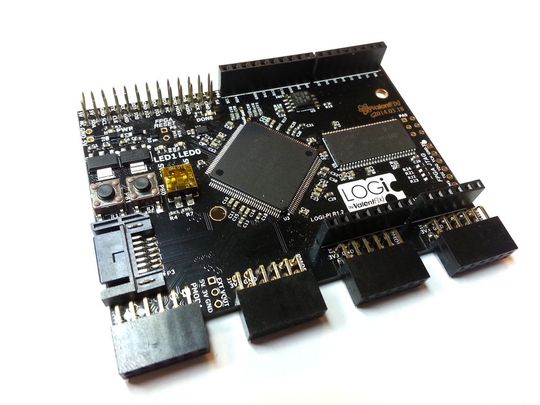

Anders als herkömmliche integrierte Schaltkreise (ICs), bei denen ein Großteil der Funktionen festgelegt ist, ist ein FPGA ein vergleichsweise unbeschriebenes Blatt. Der Begriff „Gate Array“ bezieht sich auf die Logikgatter, die so konfiguriert werden können, dass sie digitale Schaltkreise wie Schaltungen, Addierer oder Multiplikatoren erzeugen. Diese lassen sich wiederum kombinieren, um noch komplexere digitale Funktionen zu erstellen. Zudem ist es möglich, einen umfassenden Mikrocontroller in einer FPGA-Struktur umzusetzen, wodurch sich Stückkosten und somit auch die Gesamtkosten eines Produkts reduzieren lassen.

Während die Anordnung von Gattern erklärt, was innerhalb eines FPGA passiert, nutzen die Bausteine in vielen Fällen Look-up-Tabellen, um die Ausgangsleistung eines Karnaugh-Diagramms nachzustellen. Dieses Diagramm dient zur übersichtlichen Darstellung und Vereinfachung Boolescher Funktionen. Die Anzahl der Elemente in einer Look-up-Tabelle (von Herstellern oftmals als LUT abgekürzt) bestimmt im Endeffekt, wie komplex die entsprechende Boolesche Funktion sein kann.

Heute verfügen Bausteine über Tausende LUTs. Glücklicherweise sind Entwickler jedoch nicht mehr für die Übersetzung von Logikausdrücken in der Look-up-Tabelle verantwortlich – das macht die Entwicklungsumgebung des Herstellers. Sie ist auch für die Konfiguration eines FPGA verantwortlich (aus Leistungssicht) und entscheidet, welche Funktion wo im Gerät untergebracht wird. Diese Planung, im Englischen auch „Floor Planning“ genannt, ist nicht nur für die Leistungsoptimierung wichtig, sondern trägt auch zur Maximierung der Auslastung eines Geräts bei. Aus diesem Grund wird die Technologie von FPGA-Herstellern wohl gehütet. Das Front-End-Design kann jedoch oftmals durch verschiedene Entwicklungsumgebungen von anderen Anbietern bearbeitet werden, was es Entwicklern ermöglicht, die Umgebung ihrer Wahl zu verwenden.

Das erstreckt sich sogar auf die Art und Weise, wie das Design eingegeben wird. Die Branche unterstützt zwei Sprachen, die speziell für die Entwicklung von Hardware konzipiert wurden; VHDL und Verilog. Hierbei handelt es sich um sogenannte Hardwarebeschreibungssprachen (HDLs), da diese die Logikfunktionen und deren Verbindungen buchstäblich so beschreiben, wie höhere Programmiersprachen es in der Software-Entwicklung tun. Eine der beliebtesten Sprachen aus dem Bereich der Software-Entwicklung, C++, wurde zu angepasst und erweitert, dass sie als HDL verwendet werden kann. Hier ist sie unter dem Namen SystemC bekannt. Anders als Softwaresprachen funktionieren HDLs zeitgleich; das heißt, die gesamte beschriebene Hardware läuft zur gleichen Zeit, unabhängig davon, wo sie im Verzeichnis auftaucht. Dieser gleichzeitige Betrieb gehört zu den wichtigsten Konzepten, die Entwickler für die Entwicklung von FPGAs (oder ASICs) verstehen müssen.

Ebenso wie auch HDLs können FPGAs mithilfe einer herkömmlichen Schaltungserfassung entwickelt werden. Aufgrund ihrer zunehmenden Komplexität und Kapazität ist es heutzutage oftmals jedoch praktikabler, komplexe FPGAs auf Makroebene mithilfe vorab entwickelter (und geprüfter) Funktionen innerhalb einer Entwicklungsumgebung aufzusetzen.

Führende Anbietern von FPGAs, darunter Xilinx und Intel (nach dessen Übernahme von Altera), bieten zu diesem Zweck ganze Bibliotheken an Logikblöcken (auch IP, Intellectual Property) an. Auch unabhängige Unternehmen entwickeln IP; in vielen Fällen handelt es sich hierbei um die gleiche IP wie sie ASIC-Entwickler in maßgeschneiderten Chipdesigns verwenden würden.

Wie funktioniert ein FPGA?

Programmierbare Logikbausteine gibt es bereits sehr mehreren Jahrzehnten. Mit der Zeit sind sie jedoch immer komplexer geworden. Ihr reguläres Aufbaumuster hat es der Halbleiterindustrie zudem ermöglicht, Innovationen voranzutreiben. Somit gehören FPGAs in der Regel zu den ersten um Handel erhältlichen ICs, die im Rahmen modernster Prozesse hergestellt werden.

Ihre grundsätzlich hohe Leistungsfähigkeit und kurzen Entwicklungszyklen (im Vergleich zu maßgeschneiderten ASICs) machen sie zu einer beliebten Lösung für Anwendungen, bei denen die Leistung im Vordergrund steht und der Wettbewerb groß ist, wie z. B. in der Telekommunikationsbranche. Aktuell integrieren immer mehr FPGA-Hersteller neben den üblichen konfigurierbaren Strukturen festgelegte Versionen. Das liefert Entwicklern die Flexibilität eines FPGA und den Komfort einer vorab konfigurierten Funktion, wodurch auch die Anzahl der möglichen Einsatzbereiche steigt.

Da FPGAs im Rahmen modernster Herstellungsprozesse gefertigt werden, bieten sich auch hier Vorteile. Dazu gehört natürlich eine höhere Transistordichte, jedoch auch eine geringere Leistungsfähigkeit. Schon früh wurden FPGAs für ihren relativ hohen Stromverbrauch im Vergleich zu Bausteinen mit festen Funktionen kritisiert; dies ließ sich jedoch nicht vermeiden, da für die gleiche Funktion typischerweise wesentlich mehr Transistoren eingesetzt werden mussten. Die Halbleiterindustrie hat sich jedoch darauf konzentriert, die Leistungsdichte in den Fertigungsprozessen zu reduzieren, um mehr Transistoren integrieren zu können. Das Ergebnis ist, dass FPGAs heute einen sehr geringen Stromverbrauch aufweisen können und somit für eine Vielzahl von Anwendungen in Frage kommen – sogar für batteriebetriebene Geräte.

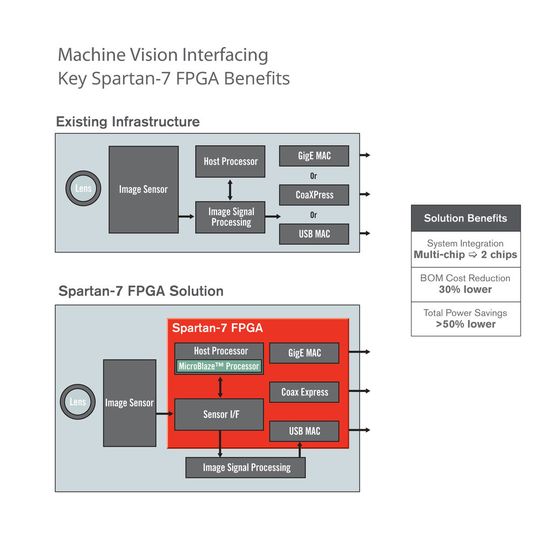

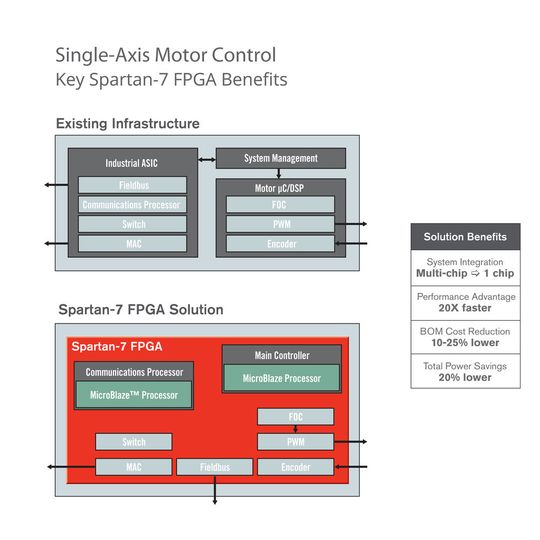

So bieten die FPGAs der Produktreihe Spartan-7 von Xilinx 30 Prozent mehr Leistung als bisherige Generationen, verbrauchen dabei jedoch nur halb so viel Strom.

Wie werden FPGA oder SoC programmiert?

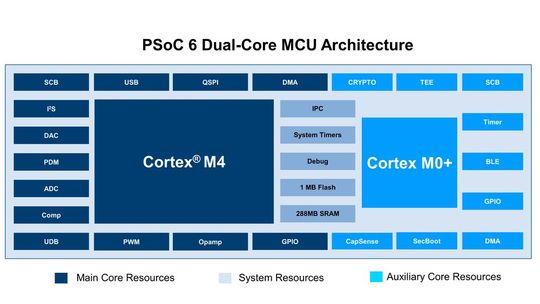

Ein weiteres Beispiel für eine programmierbare Lösung ist die PSoC-Produktreihe von Cypress Semiconductor. Hierbei handelt es sich um hochgradig integrierte Bausteine, die ein wesentlich höheres Maß an Konfigurierbarkeit als andere programmierbare Bausteine bieten, da sie sich sowohl digital als auch analog konfigurieren lassen. Bei PSoCs handelt es sich nicht einfach nur um eine Anreihung von Logikbausteinen; mithilfe von Switched-Capacitor-Technologien können sie sogar analoge Funktionen nachahmen. Dazu kommen noch feste Funktionen und, zumindest im Falle der Produktreihe PSoC 6, duale Mikrocontroller-Prozessorkerne (ein ARM Cortex-M4 sowie ein ARM Cortex-M0+). Das PSoC 6 wird im Rahmen eines 40-nm-Prozesses gefertigt, wodurch es mehr Leistung bei einem besonders geringen Stromverbrauch erbringen kann.

Die Entwicklung hin zu festen Funktionen bedeutet, dass Entwickler programmierbare Bausteine nicht mehr einfach nur als ungebundene Gatter betrachten müssen. Stattdessen sollten sie sie als ein System mit festen Funktionen ansehen, die eng integriert sind und durch eine konfigurierbare Struktur ergänzt werden. Diese Bausteine lassen sich in der Regel mithilfe eines relativ einfachen „Drag-and-drop“-Vorgangs anpassen, was eine Reduzierung der Komplexität bedeutet.

In vielen Fällen scheint die gesteigerte Flexibilität bereits Grund genug zu sein, programmierbare Bausteine wie ein FPGA einer alternativen Lösung auf Systemebene vorzuziehen. Ihre Vorteile erstrecken sich jedoch über ihre Flexibilität hinaus auch auf ein hohes Maß an Kosteneffizienz und Leistungsfähigkeit.

Bisher wurden FPGAs meistens als Alternative zu maßgeschneiderten Lösungen, auch ASICs (Application Specific IC) genannt, gewählt. In dieser Hinsicht senken FPGAs einmalige Fixkosten (NRE, Non-Recurring Engineering Cost), die vor allem die Prüfungsphase eines Designs betreffen (welche im Falle von ASICs sehr lang ausfallen kann). Während ASICs wesentlich geringere Stückkosten als ein FPGA aufweisen, sprechen die hohen NRE (bei denen die Entwicklungsdauer bereits eingerechnet ist) aus finanzieller Sicht oftmals für FPGAs.

Im Vergleich mit standardmäßigen Logikbausteinen oder anwendungsspezifischen Standardbauteilen (ASSPs, Application Specific Standard Parts) sowie mit Mikrocontrollern und Digitalsignal-Prozessoren (DSPs) kann ein FPGA oftmals mehr Leistung erbringen. Wie bereits zuvor erklärt lässt sich Hardware wesentlich schneller umsetzen als Software, was vor allem darauf zurückzuführen ist, dass Hardware zeitgleich betrieben wird.

Dies lässt sich in einem FPGA ganz einfach durch Parallelität hochskalieren; der gleiche Funktionsblock kann innerhalb der FPGA-Struktur mehrfach wiederholt werden, sodass in sehr wenigen Taktzyklen viele Ergebnisse erzeugt werden können. Das wird vor allem in Anwendungen deutlich, die DSP-Funktionen erfordern; viele FPGAs verfügen heute über dedizierte DSP-Blöcke, die sich durch Parallelität innerhalb der Struktur anpassen lassen. Das gilt zum Beispiel auch für die Erstellung mehrerer hundert Multiply-Accumulate-Blöcke.

Viele (jedoch nicht alle) FPGAs werden beim Hochfahren durch einen (in der Regel externen) nicht volatilen Speicherbaustein konfiguriert, der den für die Konfiguration erforderlichen Bitstream enthält. Dies demonstriert einen weiteren Vorteil von FPGAs: Sie lassen sich auch nach Abschluss der Fertigung noch umprogrammieren. Heutzutage ist es üblich, Over-the-Air-Firmware-Updates für Mikrocontroller- oder Mikroprozessor-Software herauszugeben. Ebenso lohnt es sich, die Hardwarefunktionen eines FPGA „im Feld“ neu zu konfigurieren.

Auch das Thema Sicherheit während der Entwicklung wird für viele Hersteller immer wichtiger. Indem größere Bestandteile eines Systems in einen zentralen Baustein wie ein FPGA integriert werden, lässt sich auch die Designsicherheit erhöhen, während Stück- und Gesamtkosten gesenkt werden. Zudem sind FPGAs heute mit innovativen Sicherheitsfunktionen ausgestattet, um das IP von Kunden und die vom System verarbeiteten Daten zu schützen.

Für wen lohnen sich FPGAs

Die Entwicklung von Elektronikprodukten ist eine Herausforderung. Der Trend hin zu mehr Konnektivität in allen Bereichen ist nur einer der Gründe dafür, warum Systeme immer komplexer werden. Lösungen auf Systemebene, wie z. B. FPGAs, können diese Komplexität erheblich senken, da sie einen flexiblen Designansatz auf hohen Abstraktionsstufen bieten.

FPGAs bieten heutzutage einige der Spitzenwerte in Sachen Leistung pro Watt, was sie zu einer idealen Lösungen für eine Vielzahl von Anwendungen macht. Noch nie war Flexibilität so effizient.

* Steve Carr ist Head of Global Marketing bei Premier Farnell.

(ID:45003991)

:quality(80)/p7i.vogel.de/wcms/02/46/0246a163cd4f770fc4ec4707eed026a3/0118485226.jpeg)

:quality(80)/p7i.vogel.de/wcms/1d/33/1d33974fef7933ea30c16340eebef3c9/0118272751.jpeg)

:quality(80)/p7i.vogel.de/wcms/de/e9/dee92adb2d0ccca12fc131b4b55a4c51/0118262284.jpeg)

:quality(80)/p7i.vogel.de/wcms/56/3d/563df7482bac59034c2c1ba6949eabeb/0118519606.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/e7/04e7948f02e1d792f245d19fbb6f84be/0118504854.jpeg)

:quality(80)/p7i.vogel.de/wcms/03/c5/03c5925ec95a2630b71e941343a128c5/0118433867.jpeg)

:quality(80)/p7i.vogel.de/wcms/0d/76/0d76806079a5a3d36aacdb006a7aba5a/0118407519.jpeg)

:quality(80)/p7i.vogel.de/wcms/7e/bb/7ebbb9e0afa7f66bd9abed55322eb88e/0118350007.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/89/0f89b224c4b3bb6fda7cbec9c56d9072/0118533982.jpeg)

:quality(80)/p7i.vogel.de/wcms/1a/0d/1a0d73826922a88118e8f6e04799665d/0118425986.jpeg)

:quality(80)/p7i.vogel.de/wcms/72/5f/725fbe6121731518e12f6d0b8d7397cd/0118433936.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/a5/43a5630d2a63fbe82f29e17b71d5dcb3/0118499684.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/47/7447ac45f80368ce7f86b76af1c6da99/0118407224.jpeg)

:quality(80)/p7i.vogel.de/wcms/ce/39/ce39569b6845cb072030fdf6505fb7c5/0118404058.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/22/c9228b8ec955c03dc075e8875f4cabf8/0117754897.jpeg)

:quality(80)/p7i.vogel.de/wcms/07/6f/076f09c7a697f193091a6e6be846aef1/0117862638.jpeg)

:quality(80)/p7i.vogel.de/wcms/30/51/305138abdaeda721646661bf6ac4fdbd/0117756540.jpeg)

:quality(80)/p7i.vogel.de/wcms/3c/b9/3cb980e98baaaadddf69a5dad4ad20a0/0117334644.jpeg)

:quality(80)/p7i.vogel.de/wcms/31/8c/318c8c9e8d61814564d11967ccc14c04/0118494408.jpeg)

:quality(80)/p7i.vogel.de/wcms/eb/6c/eb6c99643aca684c44f5ad0411d71f3f/0118318941.jpeg)

:quality(80)/p7i.vogel.de/wcms/79/4b/794b7d23361d39306753a0abab662274/0117836261.jpeg)

:quality(80)/p7i.vogel.de/wcms/84/64/846421e1abb64717319a401a350ed9ff/0118471925.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/06/b606e1899c3d19b8ac0bf5cdada67cd8/0118340949.jpeg)

:quality(80)/p7i.vogel.de/wcms/42/a0/42a0d035baeb02bf4467dd19ad99f583/0118352721.jpeg)

:quality(80)/p7i.vogel.de/wcms/36/94/36944586a51513ee0dc4cbb1fa410689/0118252602.jpeg)

:quality(80)/p7i.vogel.de/wcms/9c/bc/9cbcc8436fa8e226234cebdd1a101d61/0118377191.jpeg)

:quality(80)/p7i.vogel.de/wcms/70/91/7091aed6e9292abc5451815f9499984b/0118509991.jpeg)

:quality(80)/p7i.vogel.de/wcms/08/de/08de3cefb97266232f475bb011d9b0c6/0118162151.jpeg)

:quality(80)/p7i.vogel.de/wcms/e1/59/e15978926ae2637c5cc1cb07fc9428a6/0118508628.jpeg)

:quality(80)/p7i.vogel.de/wcms/c2/66/c266c5cfbc51fb7d06557ee079d406bf/0116839110.jpeg)

:quality(80)/p7i.vogel.de/wcms/3a/1a/3a1a267224e51b795ccc6b8df959f18e/0115998041.jpeg)

:quality(80)/p7i.vogel.de/wcms/3d/14/3d1447535880e284712d1daba8d7d466/0115848899.jpeg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/119600/119672/65.png)

:fill(fff,0)/p7i.vogel.de/companies/64/21/64219ce08bf52/logo.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/5f/15/5f157c2d880f4/ish-logo2020.jpg)

:quality(80)/p7i.vogel.de/wcms/78/a5/78a5a522e41f5e960dcba4d8a9b3e10c/0112223660.jpeg)

:quality(80)/p7i.vogel.de/wcms/c9/22/c9228b8ec955c03dc075e8875f4cabf8/0117754897.jpeg)